Bloomberg — Nvidia Corp. (NVDA) ha anunciado un nuevo procesador de IA actualizado que da una sacudida a la capacidad y velocidad del chip, buscando de esta manera de cimentar el dominio de la empresa en un mercado floreciente.

El Superchip Grace Hopper, una combinación de chip gráfico y procesador, recibirá un impulso de un nuevo tipo de memoria, dijo Nvidia el martes en la conferencia Siggraph de Los Ángeles. El producto se basa en la memoria de alto ancho de banda 3, o HBM3e, capaz de acceder a la información a la friolera de 5 terabytes por segundo.

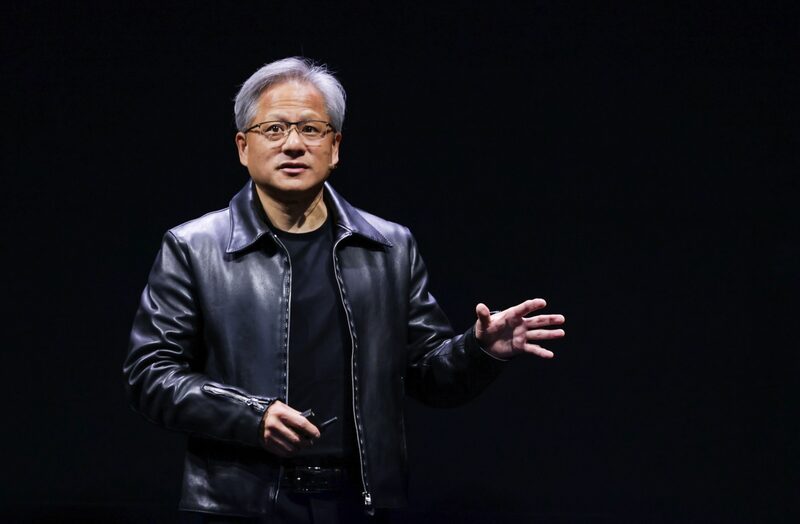

El Superchip, conocido como GH200, entrará en producción en el segundo trimestre de 2024, dijo Nvidia. Forma parte de una nueva línea de hardware y software que se anunció en el evento, una exposición de informática y gráficos en la que interviene el CEO, Jensen Huang.

Nvidia se ha labrado una temprana ventaja en el mercado de los llamados aceleradores de IA, chips que destacan en el cálculo de datos en el proceso de desarrollo de software de inteligencia artificial. Esto ha contribuido a que la valoración de la empresa supere el billón de dólares este año, convirtiéndola en el fabricante de chips más valioso del mundo. El último procesador indica que Nvidia pretende dificultar que rivales como Advanced Micro Devices Inc. (AMD) e Intel Corp. (INTC) le alcancen.

En la era de la IA, Huang ve su tecnología como un sustituto de los equipos tradicionales de los centros de datos. Dijo que una instalación de US$100 millones construida con equipos antiguos puede sustituirse con una inversión de US$8 millones en su nueva tecnología. Ese tipo de instalación consumiría 20 veces menos energía, dijo Huang.

“Esta es la razón por la que los centros de datos del mundo están pasando rápidamente a la informática acelerada”, dijo a la audiencia. “Cuanto más compras, más ahorras”.

Huang ha convertido un negocio de chips gráficos de 30 años de antigüedad en el principal vendedor de equipos para entrenar modelos de IA, un proceso que implica cribar cantidades ingentes de datos. Ahora que herramientas de IA como ChatGPT y Google Bard están calando entre los consumidores y las empresas, éstas se apresuran a incorporar la tecnología de Nvidia para gestionar la carga de trabajo.

Las acciones de Nvidia se han más que triplicado este año, lo que ha elevado su valoración a cerca de US$1,1 billones. Es la mayor ganancia en 2023 para las empresas del Índice de Semiconductores de la Bolsa de Filadelfia, que se sigue muy de cerca. Aunque Nvidia bajaba cerca de un 2% el martes, redujo brevemente las pérdidas tras anunciar el chip GH200.

El Superchip servirá como corazón de un nuevo diseño de ordenador servidor que puede manejar una mayor cantidad de información y acceder a ella más rápidamente, una ventaja clave dado el tsunami de datos que fluyen a través de los modelos de IA. El entrenamiento de la inteligencia artificial recibe un impulso si el chip puede cargar un modelo de una sola vez y actualizarlo sin tener que descargar partes a formas más lentas de memoria. Esto ahorra energía y acelera todo el proceso.

En los servidores se pueden instalar dos de los chips juntos, lo que ofrece más de 3,5 veces la capacidad de un modelo existente, según Nvidia. Esto permitirá a los clientes instalar menos máquinas o realizar el trabajo mucho más rápidamente.

Los últimos productos de Nvidia están diseñados para extender la IA generativa (y su hardware subyacente) a aún más sectores, simplificando el uso de la tecnología. Una nueva versión del software AI Enterprise de la empresa facilitará el proceso de entrenamiento de los modelos, que pueden generar texto, imágenes e incluso vídeo a partir de sencillas instrucciones.

La gama también incluye nuevos chips para estaciones de trabajo, computadoras diseñadas para grandes cargas de trabajo. El nuevo software AI Workbench, por su parte, ayuda a los usuarios a alternar su trabajo con modelos de IA entre distintos tipos de computadoras.

Con la herramienta Workbench, los usuarios pueden trasladar sus modelos y su trabajo de entrenamiento de los PC a las estaciones de trabajo, a los centros de datos e incluso a los servicios de nube pública. El programa gestiona el proceso de ajuste del software de IA para adaptarlo a la plataforma actual. La idea es ayudar a estimular una mayor demanda de los procesadores de Nvidia, independientemente del sistema en que se ejecuten.

La empresa con sede en Santa Clara, California, también anunció una asociación con Hugging Face, un popular desarrollador de modelos y conjuntos de datos de IA. Hugging Face añadirá a su sitio web un servicio de entrenamiento que utiliza Nvidia DGX Cloud, lo que permitirá a los usuarios aprovechar los servidores del fabricante de chips para gestionar sus cargas de trabajo.

Además, Nvidia está añadiendo IA generativa a su oferta Ominverse, una plataforma diseñada para soportar mundos virtuales de estilo metaverso. La empresa está utilizando la tecnología para ayudar a sus clientes corporativos a crear versiones en línea de cosas del mundo real, como fábricas y vehículos.

Para animar a otros a utilizar la tecnología, Nvidia ha respaldado un estándar denominado descripción universal de escenas, desarrollado originalmente por Pixar, de Walt Disney Co. El fabricante de chips ha formado una alianza con Pixar, Autodesk Inc, Adobe Inc y Apple Inc para intentar acelerar su adopción.

Lea más en Bloomberg.com