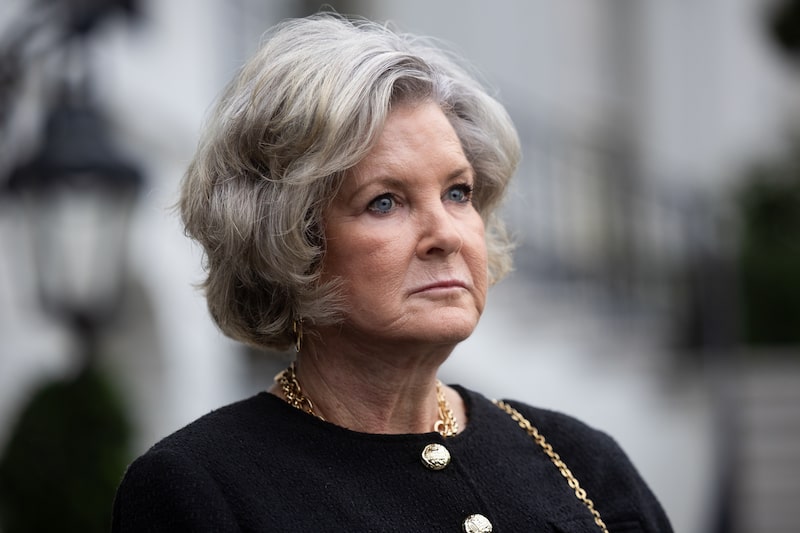

Bloomberg — La jefa de gabinete de la Casa Blanca, Susie Wiles, dijo que el gobierno estadounidense se abstendría de elegir ganadores y perdedores en inteligencia artificial, la última señal de una alta ayudante del presidente Donald Trump mientras su administración prepara nuevas directivas políticas sobre IA.

Wiles emitió la declaración el miércoles desde su nueva cuenta en X, mientras se arremolinan las preguntas sobre si la administración tratará de cribar nuevos modelos y si desescalará su disputa con Anthropic PBC.

Ver más: Las grandes tecnológicas necesitan “cada dólar” que puedan obtener para financiar la IA: Invesco

“Cuando se trata de IA y ciberseguridad, el presidente Trump y su administración no están en el negocio de elegir ganadores y perdedores”, escribió Wiles. “Esta administración tiene un objetivo: garantizar que la mejor y más segura tecnología se despliegue rápidamente para derrotar a todas y cada una de las amenazas”.

Añadió que la administración “continuará liderando un esfuerzo de America First que empodere a los grandes innovadores de Estados Unidos, no a la burocracia, para impulsar el despliegue seguro de tecnologías potentes al tiempo que mantiene a Estados Unidos a salvo.”

Wiles, que ha asumido un papel de liderazgo en la elaboración de la última ronda de la política de IA, no ofreció detalles específicos sobre el alcance o el calendario de cualquier directiva.

La Casa Blanca no respondió inmediatamente a las preguntas sobre el comunicado ni ofreció más detalles a última hora del miércoles.

Sin embargo, la declaración parecía restar importancia a la posibilidad de que la administración interviniera para intentar examinar directamente los nuevos modelos.

El Wall Street Journal informó a principios de semana de que la administración estaba considerando algún tipo de procedimiento.

El director del Consejo Económico Nacional, Kevin Hassett, dijo a principios del miércoles que la administración estaba estudiando una orden para establecer algún tipo de proceso de revisión, comparándolo con una revisión farmacéutica.

Detallaría cómo los futuros modelos “que también crean potencialmente vulnerabilidades deberían pasar por un proceso para que se liberen al mercado después de que se haya demostrado que son seguros, igual que un medicamento de la FDA”, dijo Hassett en una entrevista con Fox Business.

Añadió que era “realmente muy probable” que las pruebas previstas en la orden se extendieran en última instancia a todas las empresas de IA.

El martes, el Departamento de Comercio anunció la ampliación de un programa voluntario para probar los modelos de IA antes de su lanzamiento. Google, de Alphabet Inc. (GOOGL), Microsoft Corp. (MSFT) y xAI han acordado dar al gobierno estadounidense acceso a sus modelos para evaluar las capacidades de los sistemas y ayudar a mejorar la seguridad. OpenAI y Anthropic ya formaban parte de la iniciativa, dirigida por el Centro de Normas e Innovación en IA del departamento.

El Pentágono consideró a Anthropic y sus productos un riesgo para la cadena de suministro a principios de este año. El desarrollo del modelo Mythos de la empresa ha avivado nuevas preocupaciones; Anthropic se ha negado hasta ahora a divulgarlo públicamente.

Ver más: La Casa Blanca evalúa revisar modelos de IA previo a su lanzamiento, según NY Times

La búsqueda de un final para el enfrentamiento entre el gobierno y Anthropic se ha acelerado tras el anuncio de la empresa de que Mythos podría suponer un riesgo para la ciberseguridad mundial.

Mythos, del que se dice que es capaz tanto de detectar como de explotar vulnerabilidades de software, no ha sido divulgado ampliamente. Anthropic lo consideró demasiado peligroso para una amplia difusión y, en su lugar, ha permitido que un grupo limitado de empresas comience a probarlo en sus propios sistemas.

Con la colaboración de Maggie Eastland.

Lea más en Bloomberg.com