Bloomberg — En cuestión de meses, los chips de IA de Google se han convertido en uno de los productos más codiciados del sector tecnológico. Los principales desarrolladores de inteligencia artificial, incluidos algunos de los mayores rivales de la empresa, están haciendo acopio de ellos.

Ahora, la empresa propiedad de Alphabet Inc. (GOOGL) pretende aprovechar su impulso con la probable introducción de nuevos chips dedicados a la inferencia, o ejecución de modelos de IA después de haber sido entrenados. Con este impulso, Google se dispone a desafiar aún más al líder del mercado, Nvidia Corp. (NVDA), en una categoría de semiconductores de rápido crecimiento que se ve impulsada por la creciente adopción de software de IA.

Ver más: Denuncian que apps para generar desnudos sin consentimiento siguen activas en Apple y Google

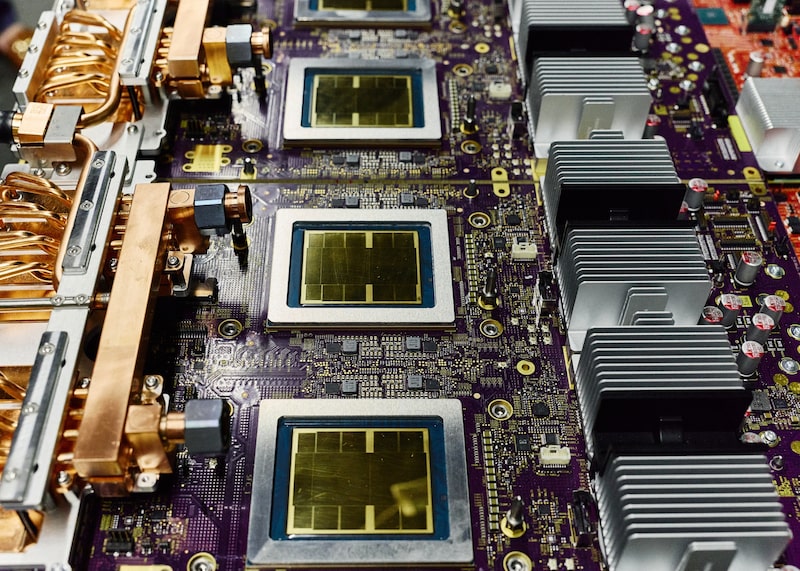

A medida que crece la demanda para procesar con rapidez las consultas sobre IA, “ahora resulta sensato especializar más los chips para el entrenamiento o más para las cargas de trabajo de inferencia”, afirmó en una entrevista el científico jefe de Google, Jeff Dean. “Estamos estudiando un montón de cosas diferentes”, añadió, incluida la velocidad de los resultados de IA que quiere permitir. La empresa tiene previsto anunciar su nueva generación de chips diseñados a medida, conocidos como unidades de procesamiento tensorial, o TPU, en la conferencia Google Cloud Next que se celebrará esta semana en Las Vegas. Amin Vahdat, que supervisa la infraestructura de IA de Google y el trabajo de chips, se negó a comentar los planes para un chip de inferencia que puede acelerar los resultados de IA, pero dijo que probablemente se compartirá más “en un futuro relativamente cercano”.

Las unidades de procesamiento gráfico (GPU) de Nvidia siguen siendo el referente en IA, especialmente para el entrenamiento de modelos más avanzados. Sin embargo, un número creciente de empresas emergentes compiten por hacerse con el control del fabricante de chips en el ámbito de la inferencia, ofreciendo chips diseñados para reducir los tiempos de respuesta de chatbots y agentes de IA. El mes pasado, Nvidia comenzó a vender un chip destinado a una inferencia más rápida, basado en tecnología adquirida de Groq como parte de un acuerdo de licencia valorado en US$20.000 millones.

Google aporta ventajas únicas a este panorama competitivo, como una década de experiencia en el diseño de chips, vastos recursos derivados de sus beneficios en búsquedas online y un conocimiento directo de los modelos de IA. Entre los principales desarrolladores de IA, solo Google fabrica sus propios chips a gran escala, lo que le permite compartir información crucial entre equipos para personalizar mejor el hardware. (OpenAI apenas está empezando a diseñar los suyos).

Ver más: Google encara demandas millonarias en arbitraje por su negocio de publicidad en línea

En una reciente entrevista en un podcast, Jensen Huang, CEO de Nvidia, destacó las ventajas de los chips de su compañía, afirmando que pueden ejecutar “una gran cantidad de aplicaciones” que “no se pueden realizar con TPU”. Por su parte, Google utiliza una combinación de TPU y GPU para su propio trabajo. “A muchos les gustaría poder trabajar con ambas”, declaró Demis Hassabis, director ejecutivo de Google DeepMind, a Bloomberg. El interés por las TPU es especialmente alto entre los principales laboratorios de IA, añadió.

Google ya había promocionado las capacidades de inferencia de sus chips. Según Partha Ranganathan, vicepresidente e ingeniero asociado de Google, también consideró lanzar chips separados para entrenamiento e inferencia desde el principio, pero hasta ahora se ha resistido a esa estrategia. Esto podría cambiar pronto, ya que el auge del gasto en IA se está desplazando del entrenamiento a la inferencia.

“El campo de batalla se está desplazando hacia la inferencia”, afirmó Chirag Dekate, analista de Gartner, quien señala que, según su experiencia, el modelo Gemini de Google es el más rápido en responder a tareas de razonamiento complejas. “En ese campo de batalla, Google tiene una ventaja en infraestructura”.

Según Natalie Serrino, cofundadora de Gimlet Labs, una startup que desarrolla software para asignar tareas de IA al chip más adecuado para cada trabajo, las TPU actuales son una opción sólida para procesar los resultados de la nueva generación de agentes de IA que realizan tareas más complejas en nombre del usuario. “Son herramientas muy útiles para la creciente carga de trabajo”, afirmó.

Un éxito repentino que tardó una década

Los esfuerzos de Google en el desarrollo de chips, que llevaban tiempo gestándose, captaron nueva atención en octubre cuando Anthropic PBC, uno de los desarrolladores de IA más observados, anunció un acuerdo ampliado para acceder a hasta un millón de TPU. Al mes siguiente, Google presentó el modelo Gemini 3, más avanzado, entrenado y ejecutado en TPU, con excelentes críticas.

Desde entonces, la demanda de chips de Google no ha hecho más que crecer entre las grandes empresas. Meta Platforms Inc. (META) firmó un acuerdo multimillonario para utilizar TPU a través de Google Cloud durante varios años. La empresa acaba de recibir acceso a su primer suministro significativo y los está probando para ver para qué tareas son más adecuados, dijo Santosh Janardhan, jefe de infraestructura de Meta. “Parece que podría haber ventajas en la inferencia”, dijo, aunque señaló que “ninguna plataforma nueva está exenta de obstáculos y una curva de aprendizaje”.

Ver más: Google añade herramientas de salud mental al chatbot Gemini tras una demanda

Anthropic también firmó un acuerdo con Broadcom Inc., socio de Google para TPU, para chips que le permitirán aprovechar aproximadamente 3,5 gigavatios de potencia de cálculo a partir de 2027. Citadel Securities planea presentar en la conferencia de Google cómo las TPU permiten a la empresa entrenar modelos más rápido que el trabajo anterior con GPU. Y G42, el conglomerado tecnológico de Abu Dabi, ha mantenido “múltiples conversaciones” con Google sobre el uso de sus TPU, según Talal Al Kaissi, CEO interino de Core42, la unidad de nube de la empresa. “Soy muy optimista”, dijo Al Kaissi sobre las conversaciones.

Google ya está dando nuevos pasos para conocer a los clientes allí donde se encuentran. La empresa está probando a dejar que empresas como Anthropic ejecuten algunas de sus TPU en sus propios centros de datos en lugar de en las instalaciones de Google, según una persona familiarizada con el asunto. También ha permitido a los clientes de TPU utilizar herramientas externas como PyTorch, así como otro software de programación, en lugar de depender únicamente de los productos de Google, dijo Vahdat.

Esos cambios están ayudando a cambiar la percepción de unos chips que nacieron de los cuellos de botella informáticos de Google y que durante mucho tiempo se consideraron principalmente útiles para que la empresa cubriera sus propias necesidades.

Después de que Dean, el científico jefe de Google, empezara a construir un sistema de software de IA anterior para que la gente pudiera utilizar los servicios de traducción de idiomas y reconocimiento de voz, se dio cuenta de que no había forma de que ni siquiera Google pudiera permitirse ofrecerlo utilizando los chips y el hardware disponibles. Al mismo tiempo, las unidades centrales de procesamiento en las que Google confiaba para la IA mejoraban a un ritmo más lento.

La empresa decidió construir un acelerador centrado en un conjunto más reducido de tareas que podrían generar los mayores costos para la IA. La idea clave detrás de la TPU es que “resuelve un número reducido de problemas, pero la cantidad de computación requerida para ellos era enorme”, dijo Vahdat, un antiguo profesor de informática que desempeñó un papel fundamental al impulsar a Google a adoptar los conmutadores ópticos que ayudan a conectar las TPU a las supercomputadoras. “En aquel momento, la opinión generalizada era que no se construía hardware especializado”.

A lo largo de los años, las TPU de Google han evolucionado a la par de su trabajo en IA. Un artículo de investigación fundamental de Google de 2017, que dio origen a los grandes modelos de lenguaje actuales, también impulsó al equipo de TPU a centrarse en chips para entrenar sistemas de IA más grandes. Posteriormente, Google DeepMind y el equipo de chips notaron que las TPU permanecían inactivas con demasiada frecuencia cuando se implementaban para el aprendizaje por refuerzo, un método popular para mejorar los sistemas de IA en tareas específicas. El equipo de TPU ajustó la forma en que conectan en red los distintos semiconductores para acelerar el flujo de datos y evitar que los chips permanezcan inactivos.

Esa dinámica continúa hoy en día mientras Google debate cuántos chips vincular en un solo “pod” o si el hardware puede ser menos preciso para ahorrar dinero. “Muchas de esas cosas están influenciadas por los experimentos con los modelos”, afirmó Hassabis. En el futuro, le encantaría que el equipo de TPU considerara fabricar un acelerador para casos de edge computing (computación en el borde), donde el chip se ubica más cerca de los usuarios en lugar de acceder a él a través de la nube, para así reducir la latencia.

Ver más: Intel consigue el compromiso de Google para utilizar chips Xeon en centros de datos

En el camino, Google también ha creado sistemas para detectar más rápidamente los defectos de fabricación que pueden tener un impacto enorme en el software. Al trabajar con chips aceleradores de IA que manejan grandes cantidades de matemáticas, incluso un fallo sutil puede propagarse y hacer que un modelo se “autodestruya por completo”, dijo Paul Barham, el científico distinguido de Google que codirige el equipo de infraestructura Gemini. Un problema de ese tipo ocurrió en Google hace unos dos años y tardó semanas en resolverse, dijo, describiéndolos como “errores infernales”.

“Ahora tenemos que hacer eso con cientos de miles de chips aceleradores en 10 segundos”, dijo.

El juego de adivinanzas

A pesar de toda su experiencia en el desarrollo de IA, Google se enfrenta a un desafío similar al de otros fabricantes de chips: los chips suelen tardar unos tres años en desarrollarse de principio a fin, pero los modelos de IA están evolucionando mucho más rápido. Eso hace que sea difícil predecir lo que los clientes querrán dentro de varios años.

“Si alguien afirma saber cómo será Géminis 10, le digo: ‘Por favor, dame lo que sea que estés fumando’”, dijo Ranganathan.

A Barham también le preocupa que la estrecha retroalimentación entre los creadores de modelos de IA y los diseñadores de hardware pueda conllevar el riesgo de pasar por alto nuevas ideas. “Existe un ciclo que te atrapa en lo que funciona bien con el software y el hardware actuales”, afirmó.

Para encontrar un término medio, el equipo de TPU a veces pretende que el chip sea lo suficientemente bueno para varios usos, aunque no sea perfecto para cada uno de ellos. La otra opción, dijo Vahdat, es planificar dos diseños diferentes. Puede que ambos no salgan al mercado, pero podrían hacerlo si el caso de uso para cada uno es lo suficientemente convincente.

A medida que los chips de Google se hagan más populares, la empresa se arriesga a sufrir limitaciones de suministro, al igual que Nvidia. Un ejecutivo de una startup, que habló bajo condición de anonimato para discutir asuntos internos, dijo que el uso de TPU por parte de su empresa se ha visto limitado por la disponibilidad y se quejó de que Google había dado efectivamente todos sus chips a Anthropic.

Ver más: Google se acerca a la búsqueda “perfecta” con ayuda de la IA y cambios en la publicidad

“Principalmente, estamos priorizando el suministro disponible para los equipos más destacados, quienes obviamente son los que podrían sacar mayor provecho de las capacidades de las TPU”, dijo Hassabis, refiriéndose a las principales empresas de IA. En el futuro, Google también deberá decidir cómo distribuir las TPU entre su creciente cartera de servicios de IA competitivos y su creciente número de clientes.

“Si bien existen ventajas al crear TPUs exclusivamente para Google, también hay desventajas importantes”, afirmó Vahdat. “Al final, se termina en lo que llamamos una isla tecnológica. Puede que sea una isla hermosa, pero tendrá una población y una diversidad limitadas. En definitiva, probablemente resultará menos beneficiosa”.

Lea más en Bloomberg.com